Експертите предупреждават, че AI може да генерира „големи епидемии или дори пандемии“ – но колко скоро?

Експертите, изследващи напредъка в региона на изкуствения разсъдък, в този момент предизвестяват, че моделите на AI могат да основат идващите „ усъвършенствани патогени, способни да предизвикват огромни епидемии или даже пандемии. "

Декларацията беше направена в публикация, оповестена в списание Science от съавтори от университета Джон Хопкинс, Станфордския университет и Фордхамския университет, които споделят, че AI моделите се „ образоват на или [са] способни свястно да манипулират обилни количества биологични данни, от ускорение на дизайна на медикаменти и ваксини до възстановяване на добивите от култури. "

" Но както при всяка мощна нова технология, такива биологични модели също ще съставляват обилни опасности. Поради естеството си с общо предопределение, същият биологичен модел, кадърен да проектира незлокачествен вирусен вектор за снабдяване на генна терапия, може да бъде употребявани за планиране на по-патогенен вирус, кадърен да избегне провокирания от имунизацията имунитет ", пишат откривателите в своето обобщение.

„ Доброволните задължения сред разработчиците да оценят евентуалните рискови качества на биологичните модели са смислени и значими, само че не могат да стоят сами по себе си “, продължава документът. „ Ние предлагаме националните държавни управления, в това число Съединените щати, да одобряват законодателство и да дефинират наложителни правила, които ще попречат на усъвършенстваните биологични модели да допринесат доста за широкомащабни рискове, като да вземем за пример основаването на нови или усъвършенствани патогени, способни да причинят огромни епидемии или даже пандемии. "

Хората се редят на опашка, с цел да получат проби за ковид във Вашингтон, окръг Колумбия, през декември 2021 година Нов документ, оповестен в Science, предизвестява за евентуалните опасности от биологичните модели на ИИ. (Ting Shen /Xinhua посредством Getty Images)

Въпреки че днешните модели на ИИ евентуално не способстват „ значително “ за биологичните опасности, „ значителното съставки за основаване на извънредно тревожни напреднали биологични модели може към този момент да съществуват или скоро ще съществуват “, цитира Time създателите на вестника.

Съобщава се, че те предлагат на държавните управления да основат „ батерия от проби “, които биологичните AI модели би трябвало да подхващат, преди да бъдат пуснати на обществеността – и по-късно оттова чиновниците могат да дефинират какъв брой стеснен би трябвало да бъде достъпът до моделите.

„ Трябва да планираме в този момент “, сподели Анита Цисеро, заместник-директор на Центъра за здравна сигурност Джон Хопкинс и един от съавторите на публикацията, съгласно Time. „ Някакъв структуриран държавен контрол и условия ще бъдат нужни, с цел да се понижат рисковете от изключително мощни принадлежности в бъдеще. “

Съобщава се, че Цицерон добави, че биологичните опасности от AI моделите могат да станат действителност „ в границите на идващите 20 години, а може би даже доста по-малко “ без подобаващ контрол.

Авторите на публикацията пишат, че „ същият биологичен модел, кадърен да проектира незлокачествен вирусен вектор за снабдяване на генна терапия, може да се употребява за планиране на по-патогенен вирус, кадърен да избегне индуциран от ваксина имунитет. " (iStock)

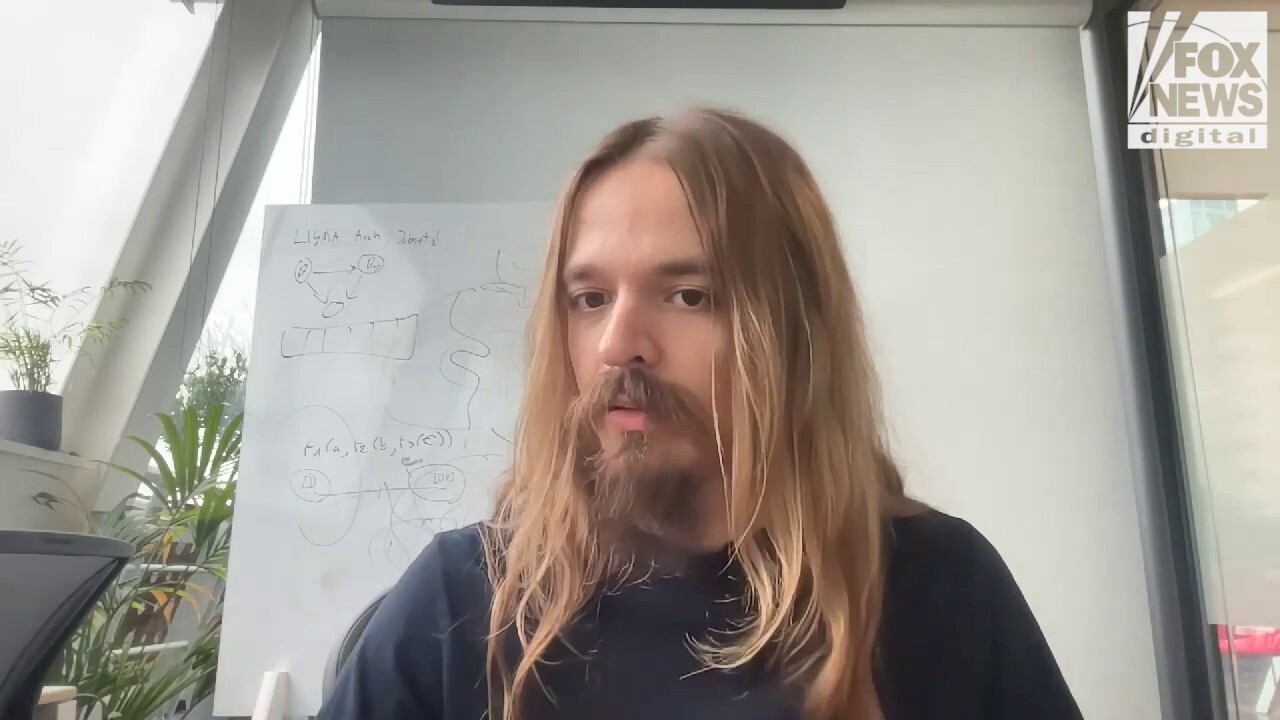

" Ако въпросът е, може ли AI да се употребява за основаване на пандемии, 100% % би трябвало да се тревожи за това, мисля, че AI напредва със скорост, за която множеството хора не са готови “, сподели Пол Пауърс, специалист по AI и основен изпълнителен шеф на Physna – компания, която оказва помощ на компютрите да проучват 3D модели и геометрични обекти – пред Fox News Дигитален.

„ Работата е там, че освен държавните управления и огромните компании имат достъп до тези все по-мощни благоприятни условия, само че също и физически лица и дребни компании “, продължи той, само че означи, че „ казусът с регулирането тук е че колкото и всички да желаят световен набор от правила за това, действителността е, че те се ползват на национално равнище е, че регулирането не се движи със скоростта на ИИ технология, каквато е била, с обичайната скорост. "

„ Това, което те оферират да извършите, е правителството да утвърди избрани модели на образование за ИИ и избрани приложения за ИИ. Но действителността е по какъв начин контролирате това? “ сподели Пауърс.

Дете получава имунизацията против COVID-19 на Pfizer-BioNTech в Блумфийлд Хилс, Мичиган, на 13 май 2021 година (Джеф Ковалски/AFP посредством Getty Images)

„ Има избрани нуклеинови киселини, които всъщност са градивните детайли за всеки евентуален същински патоген или вирус “, добави Пауърс, казвайки: „ Бих започнете оттова... Бих почнал с това, че в действителност се пробвам да разбия кой първи има достъп до градивните детайли. "

Грег Норман е кореспондент във Fox News Digital.